| この記事は検証可能な参考文献や出典が全く示されていないか、不十分です。出典を追加して記事の信頼性向上にご協力ください。(このテンプレートの使い方)

出典検索?: "シグモイド関数" – ニュース · 書籍 · スカラー · CiNii · J-STAGE · NDL · dlib.jp · ジャパンサーチ · TWL(2017年5月) |

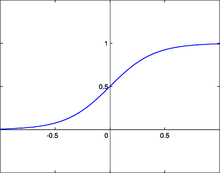

シグモイド関数(ゲイン5)

シグモイド関数(ゲイン5)

シグモイド関数(シグモイドかんすう、英: sigmoid function)は、次の式

で表される実関数である。ここで、 をゲイン (gain) と呼ぶ。

シグモイド関数は、生物の神経細胞が持つ性質をモデル化したものとして用いられる。

をゲイン (gain) と呼ぶ。

シグモイド関数は、生物の神経細胞が持つ性質をモデル化したものとして用いられる。

狭義のシグモイド関数は、ゲインを1とした、標準シグモイド関数(英: standard sigmoid function)

を指す。

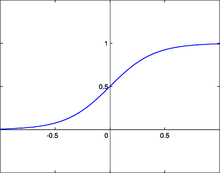

標準シグモイド関数

標準シグモイド関数

シグモイド(英: sigmoid)とは、シグモイド曲線(英: sigmoid curve)ともいい、ギリシャ文字のシグマ(語中では σ だがここでは語末形の ς のこと)に似た形と言う意味である。ただし、単にシグモイドまたはシグモイド曲線と言った場合は、シグモイド関数と似た性質を持つς型の関数(累積正規分布関数、ゴンペルツ関数、グーデルマン関数など)を総称するのが普通である。

標準シグモイド関数はロジット (logit) の逆関数であり、これになぞらえて統計処理の数値計算ライブラリでは標準シグモイド関数を expit 関数と呼んでいるものもある。

の単調増加連続関数で、後述するただ1つの変曲点を持つ。

の単調増加連続関数で、後述するただ1つの変曲点を持つ。

と

と  を漸近線に持ち、

を漸近線に持ち、

である。

また、 では、

では、

である。つまり、変曲点は  である。

シグモイド関数のグラフは、

である。

シグモイド関数のグラフは、 を中心に点対称である。すなわち、

を中心に点対称である。すなわち、 は奇関数であり、

は奇関数であり、 を満たす。

を満たす。

逆関数は、

と、ロジット関数で表せる。特に、標準シグモイド関数とロジット関数は互いに逆関数である。

導関数と二階導関数は、

と、シグモイド関数自身を使って簡潔に表せる。

自然対数と絡んで微分するとこのようになる。

他の関数との関係[編集]

ς型の関数の比較

ς型の関数の比較

シグモイド関数は、双曲線正接関数

を使って

を使って

とも表せる。またロジスティック関数

とも表せる。またロジスティック関数

において

において

とした場合に当たる。

とした場合に当たる。

導関数をシグモイド関数自身で簡単に導出できるため、微分成分が必要となるバックプロパゲーションに適している。ニューラルネットワークにおける活性化関数などで用いられる。多次元版をソフトマックス関数と言う。

関連項目[編集]

外部リンク[編集]